|

تاریخ انتشار :01.08.2025

کمپینهای

نامرئی و حباب فیلتر: چگونه شخصیسازی سیاسی، دموکراسی را تکهتکه

میکند

کسانی که به کتابهای آشپزی علاقه دارند، احتمالاً به وسایل

آشپزخانه هم علاقهمندند. اگرچه «جهش بین دستهها» در محصولات

دشوار است، مثلاً، لباسهایی که دوست دارید تنها کمی با کتابهایی

که لذت میبرید مرتبط است، اما «پروفایل ترغیب» نشان میدهد که نوع

استدلالهایی که به آنها پاسخ میدهید، از یک حوزه به حوزه دیگر

قابل انتقال است. کسی که به تخفیف «۲۰٪ اگر همین حالا بخرید» برای

سفر به برمودا واکنش نشان میدهد، به احتمال زیاد به تخفیف مشابه

برای لپتاپ جدید هم پاسخ مثبت میدهد.

دانستن نحوه تبلیغ محصولات در یک حوزه خاص یک چیز است، اما بهبود

نرخ موفقیت در هر حوزهای چیز دیگری است. وقتی شرکتی مثل آمازون با

ارائه پیشنهادهای مختلف و بررسی واکنشهای شما، پروفایل شما را کشف

کند، دلیلی ندارد که این اطلاعات را به شرکتهای دیگر نفروشد.

با روشهای جدید «تحلیل احساسات»، اکنون میتوان حال و هوای افراد

را حدس زد. افراد در روزهای خوب از کلمات مثبت بیشتری استفاده

میکنند؛ با تحلیل پیامهای متنی، پستهای فیسبوک و ایمیلهای شما،

میتوان روزهای خوب را از روزهای بد، یا پیامهای هوشیار را از

پیامهای غیرهوشیار (مثلاً با اشتباهات تایپی زیاد) تشخیص داد. در

بهترین حالت، این میتواند برای ارائه محتوای مناسب با حال و هوای

شما استفاده شود: در آینده نزدیک، در یک روز بد، پاندورا ممکن است

آلبوم Pretty Hate Machine را برای شما آماده کند. اما این اطلاعات

میتوانند برای سوءاستفاده از روانشناسی شما نیز به کار روند.

برای مثال، تصور کنید که بدانیم برخی مشتریان در زمان استرس، احساس

بد نسبت به خود، یا حتی هنگام مستی، بهصورت غیرارادی خرید

میکنند. اگر پروفایل ترغیب به دستگاه مربیگری اجازه دهد به کسانی

که تشویق مثبت را دوست دارند بگوید «تو میتوانی»، در تئوری

میتواند به سیاستمداران امکان دهد درخواستهایی بر اساس ترسها و

نقاط ضعف هدفمند هر رأیدهنده مطرح کنند.

دادههایی که محتوای شخصیسازیشده ارائه میدهند، میتوانند به

بازاریابان اجازه دهند نقاط ضعف شخصی شما را پیدا کرده و دستکاری

کنند. اگر ترغیب شخصیسازیشده برای محصولات کار کند، برای ایدهها

هم میتواند مؤثر باشد. بدون شک زمانها، مکانها و سبکهای

استدلالی وجود دارند که ما را به پذیرش آنچه میشنویم، مستعدتر

میکنند. تصور کمپینهای سیاسی که رأیدهندگان را در زمانهایی هدف

قرار میدهند که میتوانند انگیزههای منطقی ما را دور بزنند،

چندان دور از ذهن نیست.

ما بهطور شهودی قدرت افشای انگیزهها و خواستههای عمیق خود و

نحوه عملکردمان را درک میکنیم، به همین دلیل اکثر ما این کار را

فقط با افرادی که واقعاً به آنها اعتماد داریم انجام میدهیم. این

رابطه متقارن است: شما دوستانتان را تقریباً به همان اندازه که

آنها شما را میشناسند، میشناسید. اما پروفایل ترغیب میتواند

بهصورت نامرئی انجام شود؛ شما ممکن است هیچ اطلاعی از جمعآوری

این دادهها نداشته باشید و بنابراین نامتقارن است. برخلاف برخی

اشکال پروفایلسازی که آشکارا انجام میشود (مثل نتفلیکس)، پروفایل

ترغیب وقتی افشا شود، محدود میشود.

شنیدن اینکه یک مربی خودکار میگوید «تو عالی کار میکنی! این را

میگویم چون به تشویق خوب پاسخ میدهی!» اصلاً یکسان نیست.

بنابراین، شما لزوماً نمیبینید که پروفایل ترغیب در حال شکلگیری

است. نمیبینید که از آن برای تأثیر بر رفتار شما استفاده میشود.

و شرکتهایی که این دادهها را در اختیار داریم، هیچ تعهد قانونی

برای حفظ آنها ندارند. در دستان اشتباه، پروفایل ترغیب به شرکتها

امکان میدهد تصمیمگیری منطقی شما را دور بزنند، به روانشناسی

شما نفوذ کنند و اجبارهای شما را بیرون بکشند. شناخت هویت کسی، شما

را برای تأثیرگذاری بر آنچه او انجام میدهد، مجهزتر میکند.

آنچه که پیش از این گفته شد:

الی پارایزر در بررسی «حباب فیلتر» هشدار میدهد که الگوریتمهای

شخصیسازیشده، مانند دکمه «لایک» فیسبوک، با ترویج محتوای

خوشایند و همسو با علایق کاربران، مسائل پیچیده اجتماعی مانند

بیخانمانی یا مشکلات زیستمحیطی را از دید پنهان و «سندروم دنیای

دوستانه» را ایجاد میکنند که گفتوگوی سیاسی را به بازتولید

پیشفرضها محدود میکند. این فرآیند، مشابه سانسور دولتی در

کشورهایی مانند ایران، چین، ترکیه و هند، حوزه عمومی هابرماسی را

که برای گفتوگوی آزاد و نقادانه ضروری است، تضعیف میکند. هابرماس

استدلال میکند که الگوریتمها با تبدیل حوزه عمومی به «اتاقهای

پژواک» و تقویت عقلانیت ابزاری بهجای عقلانیت ارتباطی، توانایی

جامعه برای حل مسائل پیچیده و توسعه عقلانیت انتقادی را مختل

میکنند. در حالی که سانسور دولتی بهصورت آشکار روایتهای رسمی را

تحمیل میکند، الگوریتمها بهصورت پنهان تنوع دیدگاهها را کاهش

داده و هر دو، با محروم کردن شهروندان از مواجهه با «دیگری»،

دموکراسی و پروژه مدرنیته را تهدید میکنند.

اکنون این بحث را پی میگیریم:

اِلی پارایزر در ادامه این بحث میگوید با پیشرفت شخصیسازی در

تبلیغات سیاسی، کمپینها به جای هدف قرار دادن عموم مردم، بر افراد

خاص (رأیدهندگان مردد یا قابل اقناع) تمرکز کردهاند، که منجر به

پدیدهای به نام «کمپین نامرئی» شده است. در این سیستم، افرادی که

بهطور مداوم به یک حزب رأی میدهند ممکن است اصلاً متوجه وجود

کمپین انتخاباتی نشوند، زیرا اخبار و تبلیغات سیاسی برای آنها

فیلتر میشود. این شخصیسازی، همراه با گرایش به «پسامادهگرایی»

که افراد به ابراز هویت شخصی اهمیت بیشتری میدهند باعث تکهتکه

شدن سیاسی و اجتماعی شده است. مشابه برندهایی مانند پابست بلو

ریبون[۱] که برای گروههای مختلف معانی متفاوتی دارند، رهبران

سیاسی نیز برای جلب گروههای مختلف، پیامهای متفاوتی ارائه

میکنند. این تکهتکه شدن، گفتوگوی عمومی را دشوار میکند، زیرا

پیامها به قدری تخصصی و هدفمند شدهاند که رصد و نقد آنها توسط

رقبا یا روزنامهنگاران سخت است. در نتیجه، حباب فیلتر با کاهش

تجربه مشترک و محدود کردن دسترسی به دیدگاههای متنوع، توانایی

دموکراسی برای ایجاد گفتوگو و اجماع را تضعیف میکند و تهدیدی

برای حیات عمومی به شمار میرود.

کمپینهای نامرئی (تبلیغات سیاسی شخصیسازیشده) نمونهای بارز از

«قدرت مویرگی» و «تکنولوژیهای انضباطی» در جوامع مدرن هستند. فوکو

قدرت را نه به عنوان امری متمرکز در دست نهادهای حکومتی، بلکه به

مثابه شبکهای گسترده و نامرئی میداند که در تمام سطوح جامعه نفوذ

کرده و از طریق مکانیسمهای ظریف، رفتارها و ذهنیتها را شکل

میدهد.[۲] این کمپینها با استفاده از الگوریتمهای دادهمحور،

گروههای خاص را هدف قرار داده و با ارائه محتوای سفارشیشده، نه

تنها افکار عمومی را هدایت میکنند، بلکه «سوژههای مطیع» میسازند

ـ افرادی که به صورت ناخودآگاه هنجارهای مورد نظر سیستم را

درونیسازی میکنند. فوکو این فرآیند را با مفهوم «سراسربین»

(Panopticon) توضیح میدهد: درست مانند زندانی که تحت نظارت دائم

قرار دارد ولی نمیداند آیا واقعاً مشاهده میشود یا خیر، شهروندان

در عصر دیجیتال نیز تحت کنترل الگوریتمهایی هستند که ترجیحات،

رفتارها و حتی عقاید آنها را رصد و مدیریت میکنند. این کمپینها

با ابزارهایی مانند تکنیک اعتراف (تشویق کاربران به افشای ترجیحات

سیاسی در فضای مجازی) و فردیتسازی (طبقهبندی افراد بر اساس

دادههای رفتاری)، قدرت را در سطح خرد اعمال میکنند. به عبارت

دیگر، آنها نه با زور، بلکه با تولید دانش و طراحی گفتمانهای

مسلط، هژمونی خود را تثبیت مینمایند.

کمپینهای نامرئی با استفاده از الگوریتمهای شخصیسازی،

«سوژهسازی»(Subjectification) را تقویت میکنند؛ به این معنا که

افراد نهتنها بر اساس دادههای رفتاریشان دستهبندی میشوند،

بلکه هویت سیاسی آنها نیز بهصورت نامحسوس شکل میگیرد. این پدیده

بازتابی از مفهوم «قدرت مولد» فوکو است که به جای سرکوب مستقیم، با

تولید دانش و گفتمانهای خاص، رفتارها و باورها را هدایت میکند .

به گفته فوکو، چنین مکانیسمهایی «حقیقت» را میسازند[۳] و طبیعی

جلوه میدهند، در حالی که در واقع ابزاری برای حفظ روابط نابرابر

قدرت هستند. کمپینهای نامرئی نیز با حذف گروههای خاص از گفتمان

عمومی، شکلی از «حذف گفتمانی» را اجرا میکنند که مشابه منطق

«نظمبخشی به جمعیت» در تحلیلهای فوکو از زیستقدرت (Biopower)

است.[۴]

این الگوریتمها، با تولید دانش و گفتمانهای شخصیسازیشده،

«حقیقت»هایی را طبیعی جلوه میدهند که بدون نیاز به سانسور صریح

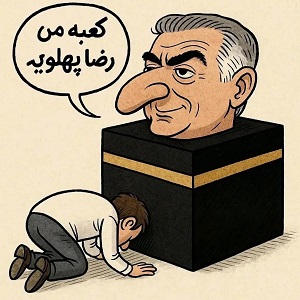

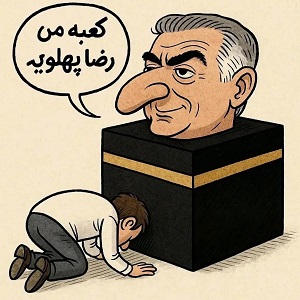

با منافع رژیمهای حاکم همسو هستند. برای مثال، در چین یا ایران که

دولتها کنترل شدیدی بر اینترنت دارند، ادغام الگوریتمهای

شخصیسازی با سیستمهای سانسور روایتهای رسمی را تقویت میکند و

گفتوگوهای مخالف را به حاشیه میراند، در حالی که به نظر میرسد

کاربران آزادانه محتوا مصرف میکنند. این فرآیند، مشابه زیستقدرت

فوکو، جمعیت را نظم میبخشد و با هدایت غیرمستقیم انتخابها، روابط

نابرابر قدرت را حفظ میکند، بدون اینکه لزوماً به سرکوب آشکار

وابسته باشد.

تکهتکهشدن سیاسی و شکلگیری «جامعه حبابی» نتیجهٔ مستقیم

الگوریتمهای شخصیسازی و رسانههای گزینشی است که بهجای تقویت

گفتوگوی عمومی، شهروندان را در اتاقهای پژواک (Echo Chambers)

محبوس میکنند. سانشتاین در کتاب جمهوریگریزی(Republic.com)

[۵]هشدار میدهد که وقتی افراد تنها با اطلاعات و دیدگاههای همسو

با باورهای قبلی خود مواجه میشوند، قطبیشدن افزایش یافته و

توانایی جامعه برای دستیابی به اجماع عقلانی کاهش مییابد. این

پدیده نهتنها فضای مشترک دموکراتیک را تضعیف میکند، بلکه به «نقص

سیستمیک» در حکمرانی منجر میشود، چرا که شهروندان فاقد مواجهه با

استدلالهای مخالف و واقعیتهای ناخوشایند میشوند. سانشتاین اصرار

دارد که دموکراسی نیازمند فضایی غیرشخصیسازیشده است که در آن

«تصادفهای سودمند» (Serendipity) بین ایدههای متنوع امکانپذیر

باشد.

در چین و ایران، سانسور دولتی بهصورت فعالانه محتوا را حذف یا

محدود میکند تا روایتهای رسمی را تقویت کند و مواجهه با

دیدگاههای مخالف را مانع شود، در حالی که الگوریتمهای شخصیسازی

بهصورت غیرمستقیم با فیلتر کردن اطلاعات بر اساس ترجیحات کاربران،

تنوع ایدهها و «تصادفهای سودمند» را کاهش میدهند. هر دو فرآیند،

توانایی شهروندان برای مواجهه با استدلالهای مخالف و واقعیتهای

ناخوشایند را محدود کرده و قطبیشدن و نقص در اجماع عقلانی را

تشدید میکنند. در این کشورها، سانسور میتواند با بهرهگیری از

الگوریتمهای شخصیسازی، کارآمدتر شود؛ مثلاً با هدایت کاربران به

محتوای همسو با خطوط حکومتی، بدون نیاز به حذف آشکار، فضای عمومی

را کنترل میکند و دموکراسی را از طریق محرومیت از گفتوگوی واقعی

تضعیف مینماید.

از سوی دیگر شخصیسازی سیاسی بازتابی از فرآیند «فردیشدن»

(Individualization) در عصر دوم مدرنیته است که نهادهای سنتی مانند

احزاب و ایدئولوژیهای جمعی جای خود را به انتخابهای شخصیشده و

سیال میدهند. اولریش بک در نظریه «جامعه خطر»[۶] استدلال میکند

که در جامعه ریسک، افراد بهصورت فزایندهای مسئول مدیریت ریسکهای

زندگی خود هستند و این شامل سیاست بهمثابه سبک زندگی میشود.

الگوریتمهای شخصیساز با تقویت این روند، سیاست را به کالایی

تبدیل میکنند که مانند کالاهای مصرفی، بر اساس سلیقه و هویت فردی

تنظیم میشود. این امر نهتنها به فروپاشی وفاداریهای سیاسی

پایدار منجر میشود، بلکه با تکهتکه کردن جامعه به خردهگروههای

خودارجاع، توانایی جمعی برای مواجهه با ریسکهای جهانی (مانند

تغییرات اقلیمی) را تضعیف میکند. به گفته بک، این وضعیت

پارادوکسیکال است: هرچند فرد احساس عاملیت بیشتری میکند، اما در

واقع در دام نظامهای تکنولوژیک و بازارمحور گرفتار میشود که

کنترل واقعی را از او سلب میکنند.

در ایران، رژیم از سانسور و کنترل اطلاعات برای محدود کردن

گفتوگوهای عمومی و تقویت روایتهای رسمی استفاده میکند، اما

ادغام الگوریتمهای شخصیسازی در پلتفرمهای دیجیتال میتواند این

کنترل را ظریفتر و مؤثرتر کند. این الگوریتمها با تبدیل سیاست به

انتخابهای فردیشده و هدایت کاربران به محتوای همسو با

ترجیحاتشان، وفاداریهای سیاسی جمعی را تضعیف کرده و جامعه را به

خردهگروههای خودارجاع تکهتکه میکنند، که توانایی مقاومت در

برابر مهندسی انتخابات را کاهش میدهد. این وضعیت، مشابه پارادوکس

بک، به افراد توهم عاملیت میدهد ـ احساس میکنند آزادانه انتخاب

میکنند ـ اما در واقع نظامهای تکنولوژیک و حکومتی با محدود کردن

مواجهه با دیدگاههای متنوع، آنها را در دام کنترل نامرئی گرفتار

میکنند. در نتیجه، شخصیسازی میتواند بهعنوان ابزاری مکمل

سانسور، با پراکنده کردن مخالفتها و کاهش انسجام اجتماعی، مهندسی

انتخابات را تسهیل کند.

zamane

________________________________________________________

توجه کنید . نوشتن یک ایمیل واقعی الزامی است . درغیر این صورت پیام

دریافت نمیشود.

|